DFG-Projekte

SFB 382 "Verfahren und Algorithmen zur Simulation physikalischer Prozesse auf Höchstleistungsrechnern"

Teilprojekt D4: Visualisierung vierdimensionaler gekrümmter Raumzeiten (2003-2006)

Teilprojekt D6: Hierarchische Visualisierungsverfahren (2000-2006)

Teilprojekt D8: Visualisierung auf Graphik-Clustern (2003-2006)

SFB 627 "Umgebungsmodelle für kontextbezogenen Systeme"

Teilprojekt C.5: Kontextbasierte mobile Visualisierung (2003-2010)

Teilprojekt D.2: Kontextbasierte Assistenzsysteme für Personen mit sensorischen Einschränkungen (2003-2010)

Teilprojekt C.6: Modellaktualisierung und Kontextgenerierung aus Bilddaten (Vorprojekt 2007-2010)

SFB 716 "Dynamische Simulation von Systemen mit großen Teilchenzahlen"

Teilprojekt D.3: Visualisierung von Systemen mit großen Teilchenzahlen

Prof. Dr. Thomas Ertl, Dr. Guido Reina

Teilprojekt D.4: Interaktive Visualisierung der Eigenschaften von Protein-Lösungsmittel-Systemen

Prof. Dr. Thomas Ertl, Apl. Prof. Dr. Jürgen Pleiss

Teilprojekt D.5: Aggregations- und Multiskalentechniken

Prof. Dr. Daniel Weiskopf

SPP 1041 "Verteilte Verarbeitung und Vermittlung Digitaler Dokumente"

Teilprojekt: Chemische Visualisierung im Internet (1999-2004)

SPP 1147 "Bildgebende Messverfahren der Strömungsanalyse"

Teilprojekt: Merkmals-Extraktion und -verfolgung (2003-2007)

SPP 1335: Teilprojekt: Visuelle Analyse von Patentinformationen (2012-2014)

Das Projekt Scalable Visual Analysis of Patent and Scientific Document Collections (Skalierbare Visuelle Analyse von Patentdokumentkollektionen und Dokumentsammlungen wissenschaftlicher Literatur) ist Teil des Schwerpunktprogramms (SPP) 1335 Scalable Visual Analytics: Interactive Visual Analysis of Complex Information Spaces (Skalierbares Visual Analytics: Interaktive Visuelle Analyse komplexer Informationsräume) der Deutschen Forschungsgemeinschaft. In den Teilprojekten wird intensiv im Bereich Visual Analytics geforscht.

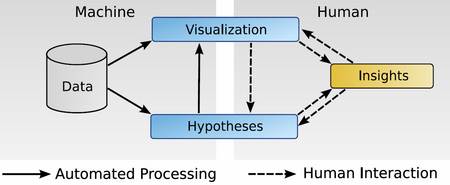

Visual Analytics ist eine junges und interdisziplinäres Forschungsgebiet welches aus dem Bereich der Visualisierung erwachsen ist und sich über maschinelles Lernen, Data Mining und Mensch-Computer-Interaktion erstreckt. Es versucht durch Kombination von Techniken aus den ebengenannten Forschungsbereichen die Probleme zu lösen, vor die uns die riesigen und immer weiter wachsenden Datenmengen des Informationszeitalters stellen, die sich mit herkömmlichen Methoden weder sinnvoll sichten, geschweige denn auswerten lassen. Visual Analytics Techniken versuchen große, oft unstrukturierte Datensätze für Analysten auswertbar zu machen, indem diese mit automatischen Methoden aggregiert und dem Analyst durch Visualisierungen übersichtlich präsentiert werden. Nutzer können dann über Interaktion mit den bereitgestellten Visualisierungen die darunterliegenden automatischen Verfahren beeinflussen und damit intuitiv ihren Berdürfnissen anpassen, um so neue Aspekte der Daten zu erkunden. Da Menschen Experten im Erkennen und Analysieren visueller Muster sind und Computer exzellent statistische Datenverarbeitung beherrschen, werden auf diese Weise die Talente beider optimal miteinander verknüpft.

Jedes Teilprojekt aus SPP 1335 deckt eine spezielle Domäne ab, der die jeweils analysierten Daten zuzuordnen sind. Beispiele sind dabei Videodaten, medizinische Daten und Daten aus biologischen Prozessen. Das auf dieser Seite präsentierte Teilprojekt beschäftigt sich mit der visuellen Analyse von Textdaten. Es ist eine Kollaboration mit Forschern aus dem Bereich des Visual Analytics unseres Visualisierungsinstituts (VIS) und Forschern im Bereich der maschinellen Sprachberarbeitung des Instituts für maschinelle Sprachverarbeitung (IMS) der Universität Stuttgart, welches aktuelle Forschung u.A. im Bereich des Information Retrievals und der statistischen maschinellen Sprachverarbeitung betreibt.

Erste Projektphase (2008-2011): Patente

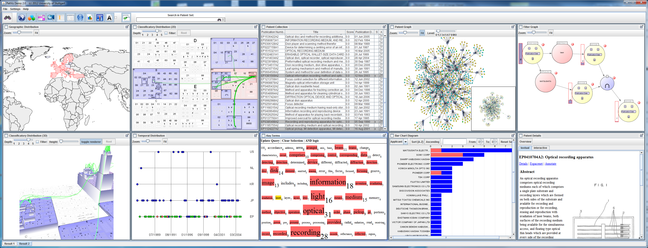

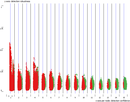

In der ersten Phase dieses Projektes stand die Analyse und visuelle Aufbereitung von Patentdaten im Mittelpunkt. Patente haben eine herausragende Bedeutung für die Wirtschaft. Da sie sich insbesondere durch hohe Heterogenität und Fehlerhaftigkeit auszeichnen bleibt ihre Analyse jedoch zeitaufwendig und fehleranfällig, zumal in den typischen Analyseszenarien eine hohe, möglichst vollständige Abdeckung der gefundenen und analysierten Patente (hoher Recall) von enormer Bedeutung ist. Da hier klassische Methoden des Information Retrievals an ihre Grenzen stoßen, wurden in der ersten Projektphase interaktive Visualisierungen entwickelt die bei der Exploration von Patentbeständen und der gezielten Suche nach Patenten Unterstützung liefern. Dabei wurden Techniken des Information Retrievals, der maschinellen Sprachverarbeitung, der Visualisierung und der Mensch-Computer-Interaktion im Sinne von Visual Analytics integriert. Aus den Forschungsarbeiten der ersten Projektphase entstand ein Prototypensystem, das Analysten bei der Patentsuche unterstützt und umfangreiche visuelle Unterstützung anbietet. Das folgende Bild zeigt einen Screenshot des PatVis Prototypen mit seinen interaktiven Visualisierungen, die eine Übersicht über z.B. die geographische Verteilung oder die am häufigsten vorkommenden Wörter von einer Menge von Patentdokumenten darstellt und durch Interaktion dem Benutzer eine gezielte Auswahl und Exploration von Untermengen ermöglicht.

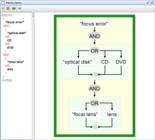

Eine der herausragenden Funktionen des PatVis Systems ist die Integration einer visuellen Anfragesprache basierend auf boolscher Logik für das Retrieval von Patentdokumenten. Boolsche Anfragelogik ist unter professionellen Patentanalysten sehr beliebt, da die Formulierung spezifischer Anfragen eine sehr genaue Kontrolle des Retrievalvorganges ermöglicht. Daher wurde in PatVis die Möglichkeit integriert eine boolsche Anfrage sowohl visuell darzustellen, wie auch durch Interaktion mit der visuellen Repräsentation die Anfrage zu editieren. Das nachfolgende Bild zeigt ein Bildschirmfoto des visuellen Anfragetools.

Unsere Partner am IMS erreichten in der Zeit der ersten Projektphase wichtige Neuerungen im Bereich des mehrsprachigen Information Retrievals, welche es erlauben, unter Einsatz intelligenter Techniken, z.B. aus dem Bereich der maschinellen Übersetzung, Anfragen in einer Sprache zu stellen, und Ergebnisse aus Patentdokumenten zu finden die in einer anderen Sprache verfasst wurden.

Zweite Projektphase (2012-2014): Wissenschaftliche Literatur

Unsere erfolgreiche Forschung mit Patentdaten hat uns gezeigt, dass im Bereich der Exploration und des Retrievals von Texten durch visuelle Methoden großes Potential liegt. Wir wollen daher in Zukunft die gewonnenen Erkenntnisse erweitern, und sind daran interessiert, entwickelte Techniken und gewonnene Erfahrung auch auf andere Textarten anzuwenden. Der Schwerpunkt der zweiten Phase liegt daher auf einer anderen Art von technischer Literatur: wissenschaftliche Veröffentlichungen. Zum einen gibt es viele Parallelen zwischen Patenten und wissenschaftlicher Literatur, zum anderen gibt es aber auch wichtige Unterschiede. Dennoch lassen sich viele Verfahren von Patenten auch auf wissenschaftliche Literatur übertragen, und gleichzeitig neu entwickelte Verfahren auch auf Patente anwenden.

Außer der Domänenanpassung bisheriger Verfahren hat sich mit der zweiten Projektphase auch die Ausrichtung unserer Forschung geändert. Der Schwerpunkt liegt nun weniger auf dem Retrieval von Dokumenten, sondern stärker auf der Exploration großer Dokumentenmengen der Literatur beispielsweise eines gesamten Wissenschaftsbereichs. Dabei ist unser Ziel die Darstellung von Themenkomplexen die zu bestimmten Zeiten besonders stark bearbeitet wurden, die Detektion von Zeitpunkten an denen ein Wechsel in diesen Themenkomplexen stattffand sowie der Detektion auftretender technologischer Innovationen. Damit sollen Forschungstrends identifiziert und aktuell aufkommende Trends und technologische Innovationen frühzeitig erkannt und ihr Potential beurteilt werden können. Desweiteren zielen wir darauf ab, neue Techniken im Sinne von Visual Analytics zu entwickeln, mit denen Analysten effektiv darin unterstützt werden, noch nicht bearbeitete Bereich auf der Wissenslandkarte zu entdecken, zu explorieren, und dadurch Ideen für Innovationen und neue, bisher nicht bearbeitete Forschungsbereiche zu entwickeln.

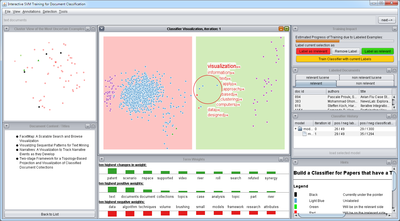

In der zweiten Projekphase haben wir bereits Fortschritte im Bereich der automatischen Zuordnung von Dokumenten zu Themengebieten erzielt. Dabei wurde ein prototypisches System entwickelt und evaluiert welches Benutzern erlaubt, ein System interaktiv darin zu trainieren, Dokumente aus zwei Themengebieten unterscheiden zu können. Dies ist wichtig, um wissenschaftliche Veröffentlichungen automatisch bestimmten Themengebieten zuordnen zu können. Das nachfolgende Bild zeigt ein Bildschirmfoto des entwickelten Prototyps.

Unser Partner am IMS haben in der zweiten Phase des Projekts Neuerungen bei der automatischen Klassifikation von Zitationen entwickelt. Diese Klassifikationsverfahren erkennen selbständig in welcher Beziehung Veröffentlichungen die von einer anderen Veröffentlichung referenziert werden zu dieser stehen.

SPP 1335: Teilprojekt "Visuelle Analyse von Videoströmen" (2009-2014)

“Scalable Visual Analytics for Video Data” is a project funded by the Deutsche Forschungsgemeinschaft (German Research Foundation) in the context of the priority program “Scalable Visual Analytics: Interactive Visual Analysis Systems of Complex Information Spaces” (1335) and started in the middle of 2008. The project is a collaboration of the Visualization Research Center, Universität Stuttgart and the Intelligent Systems Group of the University of Stuttgart.

A substantial amount of electronic data that is acquired on a regular basis is in the form of video data. A typical example is the continuous data input from closed circuit television (CCTV) cameras. The current practice of directly viewing video footage does not scale well with the amount of video because it permanently requires user attention even for, in most parts, uninteresting video material. The main goal of this project is to support users in the interactive analysis of video data in order to efficiently identify and understand regular and irregular behavior in video recordings. One challenge is that irregular behavior cannot be completely defined beforehand and, therefore, fully automatic computer vision techniques cannot provide a complete analysis. Another challenge is the difficulty of interpreting image data of complex scenarios that is often affected by noise and that contains only partial image information due to occlusion. Our strategy is to combine partially automatic image analysis with visualization and interaction: in this way, ambiguities and uncertainties in computer-based video analysis can be resolved by the human users with their excellent capabilities of interpreting image data and identifying structure. By integrating the applicants’ expertise in computer vision, visualization, perception oriented graphics, and interactive systems, this project has the goal of a scalable visual analytics tool for video which allows for video analysis on various levels of abstraction and which supports single camera and multiple camera CCTV setups.

Supplementary Material

SABS: Stuttgart Artificial Background Subtraction Dataset

Interactive Schematic Summaries

Fast-Forward Video Visualization and Adaptive Fast-Forward Techniques

IEEE VAST Challenge 2009: Video Analysis & Grand Challenge

Interactive Auditory Display to Support Situational Awareness in Video Surveillance

Inter-active Learning of Ad-Hoc Classifiers for Video Visual Analytics

- SPP 1648 "Software for Exascale Computing"

Subproject: Exascale simulation of fluid-structure acoustics interactions

FOR 372 NEXUS "Interaktionstechniken und Visualisierungsverfahren für die Verarbeitung ortsbezogener Daten auf der NEXUS-Plattform" (2001-2002)

SüKRE

Semiüberwachte Koreferenzerkennung (2009-2011)

CobraNavi: Community-based real-world accessible Navigation (2012-2014)

Einführung

Das Projekt CobraNavi setzt auf die Ergebnisse im Teilprojekt D2 des SFB 627 (Nexus) auf.

Das Projekt erforscht barrierefreie Umgebungsmodelle und Routenplanungsalgorithmen als Teil eines Navigations- und Assistenzsystems für behinderte Benutzer.

Das Fehlen eines barrierefreien und passend aufgearbeiteten Umgebungsmodells stellt oft ein Hindernis für den tatsächlichen und flächendeckenden Einsatz von Navigationssystemen für Blinde dar. Da eine kommerzielle Erfassung dieser speziellen Daten nicht zu erwarten ist, entwickelt und erforscht dieses Projekt ein System, das auf Community-basierte Daten zurückgreift. Dies gilt sowohl für die Verwendung der Daten als auch für die Erfassung oder Erweiterung von Umgebungsmodellen durch die Benutzer selbst, also z.B. blinde Personen. Dadurch soll diesen nicht nur die Erfassung tatsächlich relevanter Daten sondern auch die gleichberechtigte Teilnahme an der dem Community-Gedanken zugrundeliegenden Kultur ermöglicht werden. Diese Art der Erfassung schafft einerseits die Grundlage für ein großflächiges Umgebungsmodell, andererseits kann im Idealfall eine hohe Aktualität des Modells gewährleistet werden.

Darüber hinaus soll unter Verwendung dieser Kontextinformationen eine barrierefreie Routenplanung erfolgen. Im Gegensatz zu einer herkömmlichen Routenplanung ist dabei nicht unbedingt der schnellste oder der kürzeste Weg der beste, sondern andere Faktoren, wie z.B. Wegbeschaffenheit, Neigung, etc., spielen eine wichtige Rolle. Dies führt zwangsläufig zu einer Individualisierung der Routenplanung, abhängig von der Behinderung und den im System hinterlegten Informationen.

Publikationen

2014

2013

2012

Astro: Visualisierung von astronomischen Daten und Objekten (2010-2015)

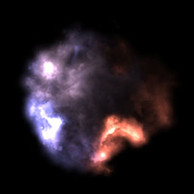

Bei diesem Forschungsprojekt werden Methoden für die naturgetreue und schnelle 3D-Visualisierung von realen astronomischen Objekten entwickelt. Insbesondere wird die räumliche Struktur von planetarischen Nebeln anhand von realen wissenschaftlichen Beobachtungen und mittels physikalischer Randbedingungen rekonstruiert. Dabei muss aus astronomischen 2D-Bilddaten ein physikalisch konsistentes 3D-Modell berechnet werden und mittels globaler Beleuchtung realistisch dargestellt werden. Ziel des Forschungsvorhabens ist es, das Verständnis von kosmologischen Phänomenen visuell und wissenschaftlich fundiert einer breiten Öffentlichkeit zu vermitteln durch den Einsatz von hoch aufgelösten Kuppelprojektionen, wie sie in modernen digitalen Planetarien vorhanden sind. Die Herausforderung dabei besteht in der interaktiven Visualisierung mit Multi-Video-Projektionen in Echtzeit, ohne langwierige Vorproduktion einer festgelegten Film-Sequenz.

|

|

|

Förderung und Kooperation

Das Projekt ist von der Deutschen Forschungsgemeinschaft (DFG) im Rahmen eines Normalverfahrens für einen Zeitraum von 3 Jahren finanziell gefördert. Das Projekt wird in Kooperation mit Prof. Dr. Marcus Magnor vom Institut für Computergrafik an der TU Braunschweig durchgeführt. Schwerpunktthema der Arbeitsgruppe in Braunschweig ist die räumliche Rekonstruktion von planetarischen Nebeln aus astronomischen Beobachtungen. Am Visualisierungsinstitut der Universität Stuttgart (VISUS) sind Prof. Dr. Daniel Weiskopf und Dipl.-Inf. Marco Ament für die realistische Darstellung der rekonstruierten Nebel verantwortlich. Dabei spielt vor allem die Parallelisierung der volumetrischen Beleuchtung auf einem Cluster und mittels moderner Grafik-Hardware (GPU) eine wichtige Rolle, um eine hochaufgelöste Darstellung in Echtzeit zu erreichen. Des Weiteren werden visuelle Einflüsse der speziellen und allgemeinen Relativitätstheorie in die Visualisierung integriert, um weitreichende kosmologische Effekte zu verdeutlichen. Hier gibt es eine enge Kooperation mit dem Projekt „Visualisierung in der speziellen und allgemeinen Relativitätstheorie“.

Visualisierungstechniken

Die Darstellung der Nebel erfolgt durch Verfolgung von Lichtstrahlen (Ray Casting). Dabei wird für jedes darzustellendes Pixel ein Strahl verfolgt, der durch eine physikalische Simulation den jeweiligen Farbwert berechnet. Da dieses Verfahren äußerst rechenaufwendig ist, insbesondere für großflächige und hochaufgelöste Projektionen, kommen moderne Grafikkarten und parallele Cluster zum Einsatz. Die Beschleunigung der Visualisierung wird durch Zerlegung der Bildebene in viele Teilbilder erreicht, mit einem sogenannten „Sort First“-Ansatz. Jedes der Teilbilder wird unabhängig voneinander auf jeweils einem Rechenknoten eines verteilten GPU-Clusters berechnet. Dadurch kann die Gesamtlaufzeit deutlich verbessert werden, da die Einzelbilder parallel verarbeitet werden können. Zuletzt werden die einzelnen Teilbilder zu einem großen Gesamtbild aneinander geordnet, so dass ein nahtloser Übergang entsteht. Als besondere Herausforderung gilt die Beschleunigung der mehrfachen Lichtstreuung in Nebeln, da hier eine Abhängigkeit zwischen den Teilbildern entsteht und Daten zwischen den einzelnen Rechenknoten ausgetauscht werden müssen, was zu einer verminderten Effizienz führt.

ExaScale: Simulation von Fluid-Struktur-Akustik-Wechselwirkungen

Dieses Projekt beschäftigt sich mit der Entwicklung neuer Visualisierungstechiken im Kontext massiv paralleler Simulationsumgebungen.

Im Unterschied zu herkömmlichen Visualisierungsansätzen, soll die Anwendung der entstehenden Techniken in-situ während der Simulation stattfinden. Dies bedeutet, dass die Verarbeitung und Aufbereitung der Visualisierungsinformation auf den Simulationsknoten des parallelen Systems selbst stattfindet.

Dies bringt verschiedene Vorteile mit sich. Zum einen sinkt die Netzwerklast, da nur tatsächlich darzustellende Information kommuniziert wird. Zudem stehen der Visualisierung dadurch die kompletten Daten an ihrer Quelle, den Simulationsknoten, ohne Mehraufwand zur Verfügung.

Um dies umzusetzen, entwickeln wir eine Technik, welche auf direktem Volumenrendering basiert und die dreidimensionalen skalaren Daten blickwinkelabhängig komprimiert. Darauf aufbauend, wird weiter die räumliche und zeitliche Kohärenz der zugrundeliegenden Daten genutzt, um ein Clustering räumlich-zeitlich ähnlicher Regionen durchzuführen, und die Datenmenge somit weiter zu verringern. Außerdem liegt der Fokus auf der Balancierung zwischen Simulation und Visualisierung sowie der Synchronisation zwischen Strömungslöser und Visualisierungscode.

Shape from Shading

Variationsmethoden zur Fusion von Shape from Shading und Stereo

BMBF-Projekte (Bundesministerium für Bildung und Forschung)

Integrierte Entwicklungsumgebung für vituelle Automobil-Prototypen (1999-2000)

Interaktives Design von Automobilen und deren numerische Optimierung unter Verwendung von Datamining Techniken (2002-2005)

Eine OpenSource Echtzeit-Rendering-Bibliothek als Standard für VR- und AR-Anwendungen (2001-2003)

Information Technology Online (2001-2003)

Korpuserschließung und Visualisierung deutschsprachiger Poetiken (1770-1960) für den „Algorithmic criticism“

Das Projekt ePoetics will zeigen, wie sich hermeneutische und algorithmische Verfahren, auch solche der Visualisierung, für methodisch avancierte eHumanities im Sinne eines „Algorithmic Criticism“ (Stephen Ramsay) wechselseitig anregen.

Es zielt auf eine Weiterentwicklung der eHumanities durch die Erprobung aktueller informationstechnologischer Methoden (sprachtechnologische Korpusanalyse, statistische Verfahren, Textmining, Visualisierung – Text- und Corpusviewing) am Beispiel eines für die Geisteswissenschaften zentralen Textkorpus: den Poetiken und Ästhetiken von 1770 bis 1960. Diese Texte stellen für die Literaturwissenschaft und die philosophische Ästhetik zum einen systematisches Basiswissen bereit, ohne das sich heute keine anspruchsvolle, d. h. kontextsensitive Fachtheorie und Literaturforschung betreiben lässt. Zum anderen enthalten sie selbst einen erheblichen Teil jener Metadaten (Begriffsexplikationen), derer ein eHumanities-Projekt über dieses Korpus und vergleichbare Korpora bedürfte.

Eine fehler-tolerante Umgebung für peta-scale MPI Löser (06/2011-05/2014)

Das primäre Ziel von FEToL ist eine minimalinvasive und ressourcen- effiziente Erhöhung der Ausfallsicherheit von HEC-Systemen durch einen auf dem „divide-and-conquer“- Prinzip basierenden Softwareansatz, der system- und anwendungsübergreifende Methoden zur Behandlung unterschiedlicher Ausfallszenarien implementiert.

Industrialisierung von hochauflösender Numerik für komplexe Strömungsvorgänge in hydraulischen Systemen (2013-2016)

Die numerische Simulation ist heute eine unverzichtbare Methode für sämtliche Forschungs- und Entwicklungsarbeiten im Bereich der Ingenieuranwendungen. Sie wurde zu einer Schlüssel-Technologie für die Verbesserung der Wirtschaftlichkeit, Umweltverträglichkeit und Sicherheit neu entwickelter Systeme und trägt damit entscheidend zur Wettbewerbsfähigkeit der deutschen Industrie bei. Eine ganze Reihe komplexer Strömungsprobleme in den Anwendungen stellen aber immer noch Herausforderungen für heutige und künftige Software-Werkzeuge dar. So müssen zur treffsicheren Auslegung von Fertigungsprozessen und zur Funktionsauslegung hydraulischer Systeme und Komponenten aufwändige Strömungssimulationen eingesetzt werden. Treten bedingt durch die Auflösung unterschiedlicher physikalischer Vorgänge unterschiedliche Zeit- und Raumskalen auf, können oft keine Simulationen in vertretbaren Rechenzeiten durchgeführt werden, die alle wichtigen physikalischen Phänomene einschließen. Der hohe Rechenaufwand der Simulationen lässt hier somit nur eingeschränkte Vorauslegungen zu. Eine Lösung dieser Probleme kann hier nur die Entwicklung einer effizienten ganzheitlichen Simulationsumgebung für Mehrskalenprobleme darstellen, die gemeinsame Entwicklungen sowohl in physikalischer und numerischer Modellierung als auch in Simulationstechnik, Visualisierung und effizienter Ausnutzung neuer Hardware-Komponenten nötig macht.

Die angestrebte Simulation von Systemen mit vielen Freiheitsgraden auf Höchstleistungsrechnern bringt neben den Herausforderungen an eine angepasste Numerik der Gleichungslöser auch Anforderungen an die Methoden der Analyse und Visualisierung der entstehenden Datenmengen mit sich. Dabei können die aus Discontinuous Galerkin (DG) Verfahren resultierenden Lösungen mittels traditioneller, auf Resampling beruhender, Visualisierungsmethoden nur unzureichend analysiert werden. Es wurden bereits Methoden vorgestellt, welche DG-Daten direkt visualisieren und somit effizienter und genauer sind. Diese Forschungscodes laufen aber bisher nur auf isolierter Grafikhardware parallel. Die hohe raumzeitliche Komplexität und Größe der in diesem Vorhaben angestrebten Simulationsdaten erfordern eine engere Integration von Visualisierung und Simulation, welches auch In-Situ-Visualisierung erlaubt. Dies bedingt neue Strategien zur Lastverteilung zwischen Simulation und Visualisierung sowie neue Visualisierungstechniken für die in diesem Projekt untersuchten spezifischen physikalischen Phänomene. Diese sollen einerseits dem Debugging und der Validierung dienen, andererseits stellen sie in den Anwendungen notwendige Werkzeuge zur Analyse dar.

Visual Analytics for Security Applications (2011-2014)

Ziel des Vorhabens ist es, Einschätzungen von komplexen und schwer zu überblickenden Krisen- oder Katastrophensituationen und die Analyse von Kaskadeneffekten in kritischen Infrastrukturen durch Softwareunterstützung besser und effizienter zu gestalten.

Im Teilvorhaben der Universität Stuttgart wird dabei insbesondere auf die Beschaffung aktueller und umfassender Informationen aus dem Web 2.0 gesetzt sowie auf ein schnelles Auffinden und Integrieren von für eine bestimmte Situation relevanten Informationen durch die Verwendung von Technologien aus dem Semantic Web. Die hierdurch erlangten Informationen werden dem Analysten über eine interaktive Schnittstelle zur Verfügung gestellt, um sowohl Geschwindigkeit als auch Qualität seiner Einschätzungen zu verbessern und dadurch ein optimal auf die Situation angepasstes Handeln zu ermöglichen.

Das deutsch-amerikanische Verbundprojekt VASA wird auf deutscher Seite vom Bundesministerium für Bildung und Forschung (BMBF) gefördert. Daran beteiligt sind insgesamt zwölf Partner aus den Bereichen Wissenschaft, Industrie und Katastrophenschutz sowie auch Stromnetzbetreiber.

Weitere Informationen: Pressemeldung des BMBF.

BMWi-Projekte (Bundesministerium für Wirtschaft und Energie)

Flächiger Zugang zu grafischen Oberflächen zu Blinde (2007-2011

IP-KOM-ÖV ist ein Standardisierungsprojekt, das vom Verband deutscher Verkehrsunternehmen (VDV) zusammen mit Industrie, Verkehrsunternehmen und Wissenschaft initiiert wurde.

In diesem Projekt sollen neben einer standardisierten Kommunikationsarchitektur für den öffentlichen Verkehr (ÖV), die auf dem Internetprotokoll basiert, auch Modelle und Kommunikationsdienste für mobile Endgeräte von Fahrgästen entwickelt werden.

Genauere Informationen finden Sie auf der Projektwebsite.

System zur Effizienzsteigerung und Assistenz bei Produktionsprozessen in Unternehmen auf Basis von Bewegungserkennung und Projektion

System zur Effizienzsteigerung und Assistenz bei Produktionsprozessen in Unternehmen auf Basis von Bewegungserkennung und Projektion

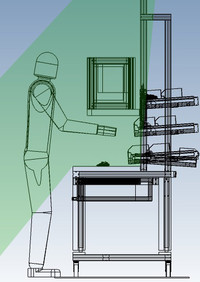

Für Produktionsmitarbeiter im industriellen Einsatz wird die Bewegungserkennung in Kombination mit Assistenzsystemen und neuen Projektionstechnologien zu einer Schlüsseltechnologie. Die Anreicherung der Arbeitswelt mit virtuellen Informationen (Augmented Reality) steigert die Effizienz und Qualität von Arbeitsabläufen. Zwar hat der Einsatz von unterstützenden Systemen in der Produktion eine lange Historie – aber nahezu alle heutigen Systeme fokussieren die Ergebniskontrolle und nicht den Arbeitsprozess selbst. Der Einsatz von Bewegungserkennung erlaubt prinzipiell die Echtzeit-Integration digitaler Informationen. So können Mitarbeiter kontextsensitiv und kognitionsunterstützend direkt im Arbeitsprozess Assistenz erhalten.

Ziel des Projektes „System zur Effizienzsteigerung und Assistenz bei Produktionsprozessen in Unternehmen auf Basis von Bewegungserkennung und Projektion“ (motionEAP) ist daher die anwenderorientierte Konzeption, prototypische Umsetzung und Evaluation eines neuartigen prozessorientierten Assistenzsystems für Produktionsprozesse. Dabei werden in einem nutzerorientierten agilen Entwicklungsprozess (user-centered design) die Anforderungen von Industrieunternehmen mit den Anforderungen älterer und leistungsgeminderter Anwender verbunden. Das neuartige Assistenzsystem überschreitet den Stand der Technik signifikant in drei Punkten:

- Integration sensorgestützter Bewegungserkennung für Echtzeit-Feedback

- In-situ-Projektion und barrierefreies Informationsdesign

- Integration motivierender Elemente (Gamification)

Mit motionEAP wird nicht mehr nur das Arbeitsergebnis kontrolliert, sondern das menschliche Arbeiten und die menschliche Kognition im Kontext unterstützt. Das System ermöglicht eine zielgerichtete Unterstützung insbesondere älterer und/oder leistungsgeminderter Mitarbeiter. Es erfasst in Echtzeit, wie die erforderlichen Arbeitsschritte ausgeführt werden und weist auf Probleme hin. Zugleich unterstützt es durch die aktive Einbeziehung ergonomischer Aspekte und motivierender Elemente ein gesundes Arbeitsverhalten, reduziert Fehlzeiten und beugt verschleißbedingten Erkrankungen vor. Insgesamt verbessert motionEAP auf diese Weise den Arbeitsprozess und die Arbeitszufriedenheit und vermeidet gesundheitliche Probleme.

Schwerpunkte der Universität Stuttgart im Projekt sind:

- Mensch-Computer-Interaktion und Interaktionsdesign (Informatik)

- Entwurf und Evaluation von multimodalen interaktiven Systemen (Informatik)

- Softwarearchitekturen für interaktive Systeme (Informatik)

- Philosophische Betrachtung von Implikationen technischer Systeme (Philosophie)

Projektpartner

- Audi AG (Projektkoordinator)

- BESSEY Tool GmbH & Co. KG

- GWW - Gemeinnützige Werkstätten und Wohnstätten GmbH

- Schnaithmann Maschinenbau GmbH

- Hochschule Esslingen

- KORION Simulation & Assistive Technology GmbH

- Robert Bosch GmbH (begleitender Partner)

MWK-Projekte

Willkommen in der Wissenschaft

Willkommen in der Wissenschaft ist ein Programm des Ministeriums für Wissenschaft, Forschung und Kunst | Baden-Württemberg (MWK). Es werden Projekte gefördert, die "die Studierenden insbesondere in der Studieneingangsphase mit innovativen Angeboten für ihr Fach [...] begeistern". Ziel ist es, den Studierenden "Perspektiven für die Forschung oder berufliche Zukunft zu geben". Das Lehrprojekt "Das digitale Archiv Stuttgart" der Universität Stuttgart ist eines von 23 Projekten, das durch Willkommen in der Wissenschaft mit maximal 300.000 Euro gefördet wird.

Was ist das DDA?

DDA steht für "Das digitale Archiv Stuttgart" und ist ein Lehrprojekt im Rahmen des Programms Willkommen in der Wissenschaft. Das Projekt soll Studienanfänger für eine Zukunft ausbilden, in der der Umgang mit großen und komplexen Mengen digitaler Texte und Bilder für fachliche Qualifikationen und beruflichen Erfolg entscheidend sind. Das Projekt setzt dabei auf Teamarbeit, intensive Betreuung und Heranführung an aktuelle Forschungsfragen. Das Lehrprojekt baut auf der existierenden Lehr- und Forschungskooperation des Deutschen Literaturarchivs (DLA) Marbach und der Neueren deutschen Literatur an der Universität Stuttgart auf. Dabei sollen neue Kooperationen mit der Fakultät Informatik, Elektrotechnik und Informationstechnik entstehen.

Das Projekt sieht Lehrveranstaltungen und Tutorien vor, welche die Studierenden an die projektförmige Erforschung von Archivalien heranführen, einen Einblick in die entsprechenden Berufsfelder geben und den dafür nötigen Teamgeist vermitteln. Um dies auf Forschungsstand zu leisten und diesen im Sinne von avancierten Digital Humanities weiterzuentwickeln, werden die Veranstaltungen um eine informationsverarbeitende Komponente ergänzt. Dies macht sie wiederum für Studierende der Fakultät für Informatik, Elektrotechnik und Informationstechnik attraktiv, die in Teams mit Geisteswissenschaftlern arbeiten. Die Kluft zwischen den Fächern soll damit abgebaut werden.

Das Projekt wurde gefördert vom Ministerium für Wissenschaft, Forschung und Kunst Baden-Württemberg.

Junior Professors Program of the Country Baden-Württemberg

Spatio-Angularly Smooth Light Field Representation, Recording and Rendering (2013-2015)

Promotionskolleg Digital Media (2012-2015)

Land Baden-Württemberg Projekte

Landesforschungsschwerpunkt GISMO: Stadt- und Landschaftsvisualisierung (2001-2002)

Landesforschungsschwerpunkt ASPIC: Application Service Providing (2001-2002)

Landesstiftung Eliteförderprogramm für Postdoktoranden: Interaktive Visualisierungsverfahren unter Berücksichtigung von nicht-photorealistischen Darstellungstechniken und perzeptuellen Aspekten (2002-2004)

Landesstiftung: Massiv parallel molekulare Simulationenund Visualisierung für die Keimbildung in Mischungen für skalenübergreifende Modelle (2004-2005)

Eliteprogramm Baden-Württemberg Stiftung: Feldvisualisierung jenseits von Advektion (2013-2015)

Programmlinie Modularisierung: Schlüsselqualifikationen im Bereich Computergraphik und Visualisierung (2005-2006)

Förderprogramm Informationstechnik (BW-FIT): Interaktive Visualisierung auf Gigapixel Displays (2006-2010)

EU-Projekte

Workbench for Interactive Contrastive Analysis of Patent Documentation (SME 2013-2015)

The iPatDoc project aims to develop new innovative technologies for

- interactive inspection

- alignment, and

- contrastive analysis of the content of patent material.

The technologies will facilitate the work on both a single patent and a patent collection with novel visual representations.

Project Partners

- Brügmann Software

- Altracon

- PatAnalyse

- Universitat Pompeu Fabra

- University of Birmingham

Material Encounters with digital Cultural Heritage (2013 - 2017)

MeSch, Material EncounterS with digital Cultural Heritage, has the goal of designing, developing and deploying tools for the creation of tangible interactive experiences that connect the physical dimension of museums and exhibitions with relevant digital cross-media information in novel ways.

A wealth of digital cultural heritage is currently available in on-line repositories and digital archives. It is however accessed only in a limited way and utilised through rather static modes of delivery. meSch will bridge the gap between visitors’ cultural heritage experience on-site and on-line by providing a platform for the creation of tangible smart exhibits. This platform will enable curators, artists, designers and cultural heritage professionals in general to create smart objects and intelligent spaces and to compose digital content to be embedded in smart objects and spaces without the need for specialised technical knowledge. Smart objects (like a magnifying glass or a replica) are enriched with digital technology while intelligent spaces embed sensors: both react to people, spaces and smart objects. A bespoke application will adapt the content and the behaviour of the object or space to visitors, their social context and the environment.

The meSch approach is grounded on principles of co-design: the participation of designers, developers and stake-holders into the process of creation and evaluation as equal partners, and on a Do-It-Yourself philosophy of making and experimenting. Three large-scale case studies in different museums provide test beds for the real-world evaluation of meSch technology with the public and cultural heritage stakeholders.

Project Partners

- Sheffield Hallam University

- University of Limerick

- Waag Society

- University of Strathclyde

- eCTRL Solucations

- DEN Foundation

- University Carlos III Madrid

- Museo Storico Italiano della Guerra

- University of Amsterdam / Allard Pierson Museum

- Museon

- Fondazione Bruno Kessler

Publikationen

2016

Lischke, Lars; Schneegaß, Stefan; Dingler, Tilman; Schmidt, Albrecht: User Defined Exhibitions – Exploring Possibilities to Involve Visitors in the Design of Museum Exhibitions. In: Postersession at the 8th International Conference on Tangible, Embedded and Embodied Interaction, 2014.

2013

Kubitza, Thomas; Pohl, Norman; Dingler, Tilman; Schneegaß, Stefan; Weichel, Christian; Schmidt, Albrecht: Ingredients for a New Wave of Ubicomp Products. In: Pervasive Computing: Ausgabe 12, Nr. 3 (2013), S. 5-8.

[XPS] [PDF] [DOI] [OpenXML] [BibTeX] [Vortragsfolien] [Details]

RECALL aims to re-think and re-define the notion of memory augmentation. Recent developments in capture technology and information retrieval allow for continuous and automated recordings of many aspects of our everyday lives. RECALL will harness these trends and develop a new paradigm for memory augmentation technologies that are technically feasible, desired by users, and beneficial to society. By combining technological interventions with basic research questions in memory psychology, we plan to elevate memory augmentation technologies from a clinical niche application to a mainstream technology, initiating a major chance in the way we use technology to remember and to externalize memory. RECALL will build on contemporary memory theories that highlight how technology augmented recall can be used to both re- enforce and attenuate memories. It will develop novel capture technologies and corresponding control mechanisms to automate the acquisition of personal memories, and investigate how feedback through ambient large displays and personal mobile devices can aid personal memory acquisition, retention, and attenuation.

Project Partners

- Lancaster University

- Universita Della Svizzera Italiano (Lugano)

- University of Essex

Cheap, textile based whole body sensing systems for interaction, physiological monitoring and activity recognition (2013 - 2016)

The SimpleSkin project proposes a fundamentally new approach to wearable sensing that will provide an unprecedented amount of information on the wearer’s activities and physiological parameters with clothes that, with respect to their properties, appearance, production process, and price will be virtually undistinguishable from today’s standard garments. In the long term this will lead to functional clothes becoming the default, much like how today's smart, sensor enabled phones have become the mainstream consumer choice.

Project Partners

- German Research Center for Artificial Intelligence

- Institute of Textile Technology and Process Engineering Denkendorf

- Eindhoven University of Technology

- Swiss Federal Institute of Technology Zurich

- Sefar AG

Publikationen

2016

2015

2014

Schneegaß, Stefan; Cheng, Jingyuan; van Laerhoven, Kristof; Amft, Oliver: Workshop on Smart Garments: Sensing, Actuation, Interaction, and Applications in Garments. In: (Noch nicht erschienen).

Schneegaß, Stefan; Hassib, Mariam A.; Birmili, Tobias; Henze, Niels: Towards a Garment OS: Supporting Application Development for Smart Garments. In: (Noch nicht erschienen).

[XPS] [PDF] [DOI] [OpenXML] [BibTeX] [Vortragsfolien] [Details]

2013

Lambda

Linear Access to Mathematics for Braille Device and Audio Synthesis (2004-2007)

PatExpert

Advanced Patent Document Processing Techniques (2006-2009)

PESCaDO

Personalised environmental service configuration and delivery orchestration (2010-2012)

PD-NE T

T

(2007-2013)

Sonstige Projekte

Designing Adaptive Ambient Notification environments

The DAAN project investigates a technical platform, which supports Aging in Place especially for seniors with mental or cognitive illnesses. The supporting notification system consists of two phases. In the learning phase, the system adjusts to the respective user's behavior and daily activites. In the executive phase the systems supports the seniors in their daily activities with providing courses of action and relevant information in context. The system shows the provided courses of actions unobtrusively with ambient and adaptive notifications. Therefore, the system will support multi-modal interfaces embedded in the user's home to interact with with user's home devices as the telephone or the TV.

Project Partners

- German Research Center for Artificial Intelligence

- Deutsche Telekom AG

- IXDS GmbH

- Inuity Media Lab

- Universität der Künste

Seminars & Workshops

- Ambient Notification Environments, Dagstuhl Seminar, Germany — April 17, 2017

http://www.dagstuhl.de/de/programm/kalender/semhp/?semnr=17161 - UbiTtention: Smart & Ambient Notification and Attention Management, Workshop in conjunction with UbiComp 2016,

Heidelberg, Germany — September 13, 2016

http://projects.hcilab.org/ubittention/ - Smarttention, Please! 2nd Workshop on Intelligent Attention Management on Mobile Devices

Workshop in conjunction with MobileHCI 2016, Florence, Italy — Spetember 6, 2016

http://mhci16.smarttention.com/ - Smarttention, Please! Intelligent Attention Management on Mobile Devices

Workshop in conjunction with MobileHCI 2015, Coopenhagen, Denmark — August 24, 2015

http://mhci15.smarttention.com/

Publikationen

2018

Auda, Jonas ; Weber, Dominik ; Voit, Alexandra ; Schneegass, Stefan: Understanding User Preferences Towards Rule-based Notification Deferral. In: Extended Abstracts of the 2018 CHI Conference on Human Factors in Computing Systems, Extended Abstracts of the 2018 CHI Conference on Human Factors in Computing Systems. Montreal QC, Canada : ACM, 2018 — ISBN 978-1-4503-5621-3, S. LBW584:1--LBW584:6

BibTeX

Link

Weber, Dominik ; Voit, Alexandra ; Kollotzek, Gisela ; van der Vekens, Lucas ; Hepting, Marcus ; Alt, Florian ; Henze, Niels: PD Notify: Investigating Personal Content on Public Displays. In: Extended Abstracts of the 2018 CHI Conference on Human Factors in Computing Systems, Extended Abstracts of the 2018 CHI Conference on Human Factors in Computing Systems. Montreal QC, Canada : ACM, 2018c — ISBN 978-1-4503-5621-3, S. LBW014:1--LBW014:6

BibTeX

Link

Voit, Alexandra ; Salm, Marie Olivia ; Beljaars, Miriam ; Kohn, Stefan ; Schneegass, Stefan: Demo of a Smart Plant System As an Exemplary Smart Home Application Supporting Non-urgent Notifications. In: Proceedings of the 10th Nordic Conference on Human-Computer Interaction, Proceedings of the 10th Nordic Conference on Human-Computer Interaction. Oslo, Norway : ACM, 2018c — ISBN 978-1-4503-6437-9, S. 936--939

BibTeX

Link

2017

Okoshi, Tadashi ; Exler, Anja ; Voit, Alexandra ; Weber, Dominik ; Pielot, Martin ; Poppinga, Benjamin ; Henze, Niels ; Gehring, Sven ; u. a.: UbiTtention 2017: 2nd international workshop on smart & ambient notification and attention management. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 2017 ACM International Joint Conference on Pervasive and Ubiquitous Computing and Proceedings of the 2017 ACM Internation on Wearable Computersal Symposium, Proceedings of the 2017 ACM International Joint Conference on Pervasive and Ubiquitous Computing and Proceedings of the 2017 ACM Internation on Wearable Computersal Symposium : ACM, 2017. — Rezensiertes Poster

BibTeX

Link

BibTeX

Link

2016

Wiehr, Frederik ; Voit, Alexandra ; Weber, Dominik ; Gehring, Sven ; Witte, Christoph ; Kärcher, Daniel ; Henze, Niels ; Krüger, Antonio: Challenges in Designing and Implementing Adaptive Ambient Notification Environments. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct, Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct, 2016

BibTeX

Link

Kubitza, Thomas ; Voit, Alexandra ; Weber, Dominik: An IoT Infrastructure for Ubiquitous Notifications in Intelligent Living Environments. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct, Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct, 2016

BibTeX

Link

Weber, Dominik ; Sahami Shirazi, Alireza ; Gehring, Sven ; Henze, Niels ; Poppinga, Benjamin ; Pielot, Martin ; Okoshi, Tadashi: Smarttention, Please! 2nd Workshop on Intelligent Attention Management on Mobile Devices. In: ACM (Hrsg.) Proceedings of the 18th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct, Proceedings of the 18th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct. (2016b)

BibTeX

Link

Voit, Alexandra ; Poppinga, Benjamin ; Weber, Dominik ; Böhmer, Matthias ; Henze, Niels ; Gehring, Sven ; Okoshi, Tadashi ; Pejovic, Veljko: UbiTtention: Smart & Ambient Notification and Attention Management. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct, Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct, 2016b

BibTeX

Link

Schneegaß, Stefan ; Voit, Alexandra: GestureSleeve: using touch sensitive fabrics for gestural input on the forearm for controlling smartwatches. In: Proceedings of the 2016 ACM International Symposium on Wearable Computers, Proceedings of the 2016 ACM International Symposium on Wearable Computers : ACM, 2016

BibTeX

Link

Voit, Alexandra ; Weber, Dominik ; Schneegaß, Stefan: Towards Notifications in the Era of the Internet of Things. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 6th International Conference on the Internet of Things, Proceedings of the 6th International Conference on the Internet of Things, 2016d. — Rezensiertes Poster

BibTeX

Link

Voit, Alexandra ; Stowell, Elizabeth ; Weber, Dominik ; Witte, Christoph ; Kärcher, Daniel ; Henze, Niels: Envisioning an ambient smart calendar to support aging in place. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct, Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct, 2016c

BibTeX

Link

Voit, Alexandra ; Machulla, Tonja ; Weber, Dominik ; Schwind, Valentin ; Schneegaß, Stefan ; Henze, Niels: Exploring Notifications in Smart Home Environments. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 18th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct, Proceedings of the 18th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct, 2016a

BibTeX

Link

Weber, Dominik ; Voit, Alexandra ; Dingler, Tilman ; Kallert, Manuella ; Henze, Niels: Assessment of an Unobtrusive Persuasive System for Behavior Change in Home Environments. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 5th ACM International Symposium on Pervasive Displays, Proceedings of the 5th ACM International Symposium on Pervasive Displays : ACM, 2016c. — Rezensiertes Poster

BibTeX

Link

Weber, Dominik ; Voit, Alexandra ; Kratzer, Philipp ; Henze, Niels: In-situ investigation of notifications in multi-device environments. In: Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing, Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing, 2016d

BibTeX

Link

Weber, Dominik ; Mayer, Sven ; Voit, Alexandra ; Ventura Fierro, Rodrigo ; Henze, Niels: Design Guidelines for Notifications on Smart TVs. In: ACM (Hrsg.) Proceedings of the ACM International Conference on Interactive Experiences for TV and Online Video, Proceedings of the ACM International Conference on Interactive Experiences for TV and Online Video., ACM (2016a)

BibTeX

Link

Weber, Dominik ; Voit, Alexandra ; Le, Huy Viet ; Henze, Niels: Notification Dashboard: Enabling Reflection on Mobile Notifications. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 18th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct, Proceedings of the 18th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct : ACM, 2016e

BibTeX

Link

2015

Weber, Dominik ; Sahami, Alireza ; Henze, Niels: Towards Smart Notifications using Research in the Large. In: Proceedings of the 17th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct, Proceedings of the 17th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct, 2015

BibTeX

Link

Sahami, Alireza ; Henze, Niels: Assessment of Notifications on Smartwatches. In: ACM ; ACM (Hrsg.) ; ACM (Hrsg.): Proceedings of the 17th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct, Proceedings of the 17th International Conference on Human-Computer Interaction with Mobile Devices and Services Adjunct, 2015. — Rezensiertes Poster

BibTeX

Link

Gevakub - Design Guidelines for Virtual Exhibitions supporting Cultural Education

Participation in cultural education and lifelong learning are key societal challenges. Museums and exhibitions form an essential part of the cultural educational for broad sections of the population. However, museums and exhibitions are naturally bound to places and thus not accessible to all. Virtual reality technologies make it possible to visualize learning environments close to reality. This makes cultural education offers accessible regardless of place or time. The GEVAKUB project aims to make cultural education accessible as a participatory and social experience in virtual spaces. For this purpose, guidelines for the use of virtual reality for the creation of cultural learning spaces will be developed. Furthermore, we are aiming at developing guidelines for designing collaborative learning spaces and for the presenting multimodal content in virtual spaces.

Project Partners

- Hamburg University of Applied Sciences

- University of Bayreuth

Bayerischer Forschungsverbund Technisch-Wissenschaftliches Hochleistungsrechnen (FORTWIHR): Visualisierung von Außenaerodynamik (1999-2001)

National Science Foundation NSF-ITR (Untervergabe Purdue University)

Teilprojekt: Visualisation of radial basis function-encoded data (2004-2005)

ASBUS

Assistenz für sensorisch Behinderte an der Universität Stuttgart (2009-2011), gefördert durch

die Universität Stuttgart

DHS VACCINE (Unververgabe Purdue University) (2011)

- SimTech | Exzellenzcluster EXC 310 "Simulation Technology" (SimTech) (2007-2018)

Subproject 5-8: Visualisation of Flow and Fracture in Porous Media (2014-2017)

Subproject 6-6: Interactive Visual Analysis of Big Simulation Data (2013 - 2017)

Subproject 7-4: Tools and methods for supporting the development of ubiquitous end-user simulations that support collective interaction (2014-2017)

Subproject 7-9: Modelling human behaviour patterns for interactive systems through research in the large (2014-2017)

Subproject: Model-Based Visual Analysis of Large Spatiotemporal Data (2017-2018)

Finished:

Subproject 5-4: Interactive visualisation of multi-scale, multi-physics simulation (2008-2011)

Subproject 8-7: Visualisation for integrated simulation systems (2008-2011)

Subproject 8-2: Coupled Simulation of Light and Sound Propagation in Complex (2009-2012) - Graduate School GSC 262 "Advanced manufacturing engineering" (GSaME) (2007-2019)

Subproject: Scalable Visual Analytics for Advanced Manufacturing (2012 - 2017)

Finished:

Subproject: Visual Analytics for Industrial Engineering (2008-2012)